La révolution des multi-agents est en marche et les entreprises commencent à déceler dans cette transformation l’impact le plus manifeste de l’IA générative : des agents d’intelligence artificielle capables d’interagir non plus seulement avec l’être humain mais directement… entre eux. Quelle entreprise dessinent-ils pour demain ? Comment maîtriser cette nouvelle technologie ? Cet article vous donne toutes les clés pour comprendre.

À bien des égards, les entreprises sont des écosystèmes. C’est-à-dire des environnements vivants, mouvants, réactifs, qui évoluent et se transforment au gré des inflexions internes et externes de leur milieu. Un délai sur une chaîne logistique ? C’est tout le staffing des centres opérationnels qui se trouve affecté. Une réglementation sur la décarbonation Scope 3 ? C’est le choix des fournisseurs qui est à revoir. Une perte de clientèle observée sur le CRM ? L’origine est peut-être à chercher du côté de défaillances du produit...

Dans cet écosystème, tout n’est que vases communicants et interconnexions : objectifs business, activités, indicateurs… les business units des entreprises évoluent désormais en organisations intégrées.

Et pourtant, les systèmes informatiques, eux, restent désespérément cloisonnés. Un système RH ne peut pas « dialoguer » avec le logiciel de supply chain, même en cas de délai. Les bases de données fournisseurs ne sont pas connectées aux indicateurs de suivi de la durabilité. Et le CRM n’est aucunement relié au développement produit, rendant illusoire ou asynchrone toute tentative de corrélation. Si une action est entreprise sur la base d’une information livrée par un système voisin, alors il s’agit souvent d’une action unique correspondant à une fonctionnalité isolée. Une corrélation ponctuelle et ciblée sur une seule problématique.

Que se passerait-il à l’inverse si tous les systèmes pouvaient communiquer entre eux au même moment ? Si le périmètre informationnel de l’entreprise ne se limitait pas à un logiciel unique ou une plateforme unique, mais à toute l’entreprise, dans toutes ses représentations informatiques ? Et si les recommandations d’actions poussées par un système ne s’appliquaient pas seulement à une fonctionnalité en particulier, mais à toutes les activités concernées de l’entreprise ?

Voici le principe et la promesse de ce qu’on nomme les « systèmes d’intelligence artificielle multi-agents ». En concentrant toutes leurs opérations sous une seule interface animée par des agents IA, les entreprises ont l’opportunité de gagner en efficacité et en qualité.

Le potentiel de transformation de cette technologie est immense et certaines entreprises ont commencé à s’y intéresser. Nous tentons dans cet article d’expliciter l’intérêt de ces multi-agents et d’en décrire le fonctionnement.

Les multi-agents : concepts et définitions

D’un point de vue historique, le concept de systèmes multi-agents n’est pas tout à fait nouveau. En réalité, le sujet existe depuis les années 1980 quand de nombreux pionniers de la technologie cherchaient à créer une entité logicielle unique, fondée sur l’intelligence artificielle. Leurs tentatives se soldèrent toutes par un échec car la puissance de calcul était alors insuffisante, tout comme la qualité des données et la pertinence des algorithmes se trouvaient encore restreintes.

Quarante ans plus tard, l’arrivée de l’IA générative et son exécution autour de nouvelles capacités de langage naturel (avec l’apparition des Large Language Models ou LLMs) bouleverse ce continuum technologique.

Et même s’il ne constitue pas techniquement l’aboutissement de la réflexion autour d’une entité logicielle unique, le système d’IA multi-agents en prend tous les attributs, matérialisant de façon moderne cette idée originale.

De quoi parle-t-on ? Un système d’IA multi-agents est un réseau d’outils IA extrêmement puissants et intelligents implantés au cœur des systèmes logiciels. Parmi ceux-ci, on retrouve notamment les modèles LLM d’IA générative imbriqués au plus près des fonctionnalités, des applications, des modules ou plus largement des fonctions logicielles. Ce « système de systèmes » fournit aux agents IA la possibilité d’interagir les uns avec les autres.

Si tous les agents d’un tel système utilisent le même LLM comme langage commun (appelons-le « LLM enveloppe »), chacun d’entre eux dispose d’un système de prompts différent, généré par LLM, qui relève strictement de son périmètre. Les agents fonctionnent alors comme un groupe de travail virtuel, en analysant les prompts et en tirant l’information depuis les différentes sources de l’entreprise pour aboutir à une réponse commune, transversale, qui ira bien au-delà des besoins du requêteur original en couvrant potentiellement les problématiques des autres équipes.

Prenons un exemple : quel pourrait être l’intérêt d’un système d’IA multi-agents dans le monde de l’industrie ? Il pourrait s’agir par exemple de demander à un agent d’approvisionnement d’analyser les process existants et, en fonction de la saisonnalité et de l’évolution de la demande, de recommander des pièces et composants alternatifs plus rentables. Cet agent d’approvisionnement pourrait ensuite se mettre en lien avec un agent de durabilité pour évaluer l’impact de ces composants alternatifs sur les données environnementales, notamment sur les indicateurs de décarbonation. En complément, un agent de réglementation viendrait vérifier la conformité de ces opérations en s’assurant que les équipes fournissent, en temps et en heure, l’intégralité des informations demandées par rapport à ces changements de fourniture.

Prenons un autre exemple, orienté sur un métier et non sur un secteur : quel pourrait être l’apport de tels systèmes sur la fonction RH, et notamment sur l’accueil d’un collaborateur ? Dans ce cas concret, il est aisé d’imaginer le rôle d’un agent d’embauche qui viendrait soumettre l’offre finale au candidat et lui faire signer le contrat. Mais on peut poursuivre la réflexion en l’imaginant transmettre le dossier à un autre agent, l’agent d’accueil, qui serait responsable du suivi administratif du nouvel embauché, de la mise à disposition de la documentation de l’entreprise et de la programmation des premières semaines. Ces agents RH auraient également la possibilité de déclencher des demandes auprès des agents IT pour effectuer des tâches comme l'attribution de postes de travail et leur configuration pour les nouveaux employés.

Dernier point, plus prospectif : un champ d’application qui pourrait se montrer particulièrement intéressant pour les systèmes multi-agents est probablement l’ERP (Enterprise Resource Planning). Par définition, un système ERP qui couvre plusieurs groupes fonctionnels au sein d’une organisation aura vocation à livrer des résultats transversaux à tous ces groupes. D’où une certaine similitude avec le rôle des systèmes multi-agents. Mais là où les ERP traditionnels auront tendance à se focaliser sur les processus business, les systèmes d’IA multi-agents auront, eux, la possibilité de couvrir un plus large spectre de finalités, tout en s’intégrant dans les architectures des systèmes ERP.

Il est donc envisageable de prolonger le bénéfice des ERP grâce à des systèmes multi-agents fondés sur les LLM : les ERP pourraient ainsi manipuler des données non-structurées et des process dynamiques, en constante évolution (là où leur fonction première était d’exécuter des process prédéfinis). Cette avancée ouvre de nombreuses perspectives en matière d’autonomie et de complexité de l’aide à la décision ainsi générée.

On l’a compris : l’IA multi-agents ouvre un nouveau territoire de réflexion, d’optimisation et d’innovation pour les entreprises. Ce mouvement est désormais enclenché et il pourrait bouleverser les organisations bien plus tôt que ce que l’on anticipe.

Résoudre les problèmes de silos

Comme l’énonçait récemment le CEO d’OpenAI, Sam Altman, les agents sont sur le point de devenir les « éminences grises de l’IA » et la technologie a le potentiel pour devenir « un collègue super compétent ». Or, derrière ce terme « éminence grise » (formulé littéralement en anglais par « killer function », ndlr), se niche également la notion de discrétion, voire même de clandestinité : une façon de souligner que la bascule vers les systèmes multi-agents s’opère déjà en secret au sein des architectures.

En effet, si l’on fait un état des lieux des applications IA en entreprise, il est aisé de constater que de nombreuses organisations intègrent déjà des chatbots alimentés par les LLM au sein de leurs intranets. Et, au même moment, des départements comme les RH, la Finance, le Juridique ou l’IT ajoutent des chatbots IA à leurs applications métiers spécifiques. Malheureusement, à l’usage, ce millefeuille de chatbots est très souvent source de maladresses ou de crispations car les collaborateurs qui formulent des requêtes via le chatbot de l’intranet transversal se retrouvent fréquemment à renouveler leur demande sur les applications dédiées de chaque département ou service.

Ce silotage est un problème : les chatbots appuyés sur les LLM sont censés se coordonner et livrer une réponse unifiée – c’est en tous cas dans cette optique que les systèmes multi-agents ont été créés. D’ailleurs, les grands du secteur ne s’y sont pas trompés et souhaitent aller vite quant à l’exploration de ce concept. Selon une récente étude Gartner, le budget de l’investissement IT des entreprises mondiales devrait atteindre 1 520 milliards de dollars cette année, une hausse notable due en grande partie aux programmes et chantiers de gen AI. Et, quand on considère les tensions marquées en matière de disponibilité des talents, il est fort probable que cette excroissance de programmes IA mène à une augmentation des dépenses auprès de cabinets de conseil spécialisés. Dans son étude, Gartner note ainsi que, pour la première fois, les entreprises ont davantage dépensé d’argent sur leurs ressources externes que sur leurs ressources internes.

Une tendance qui confirme que les entreprises sont désormais prêtes à tout pour amplifier leurs programmes d’IA et garantir le maximum de profits autour de ces investissements.

Les multi-agents : mode d’emploi

Pour mieux anticiper la valeur qui peut être générée par ces systèmes de multi-agents, il est indispensable de comprendre comment fonctionnent le système, à la fois dans son ensemble et dans chacun de ses composants.

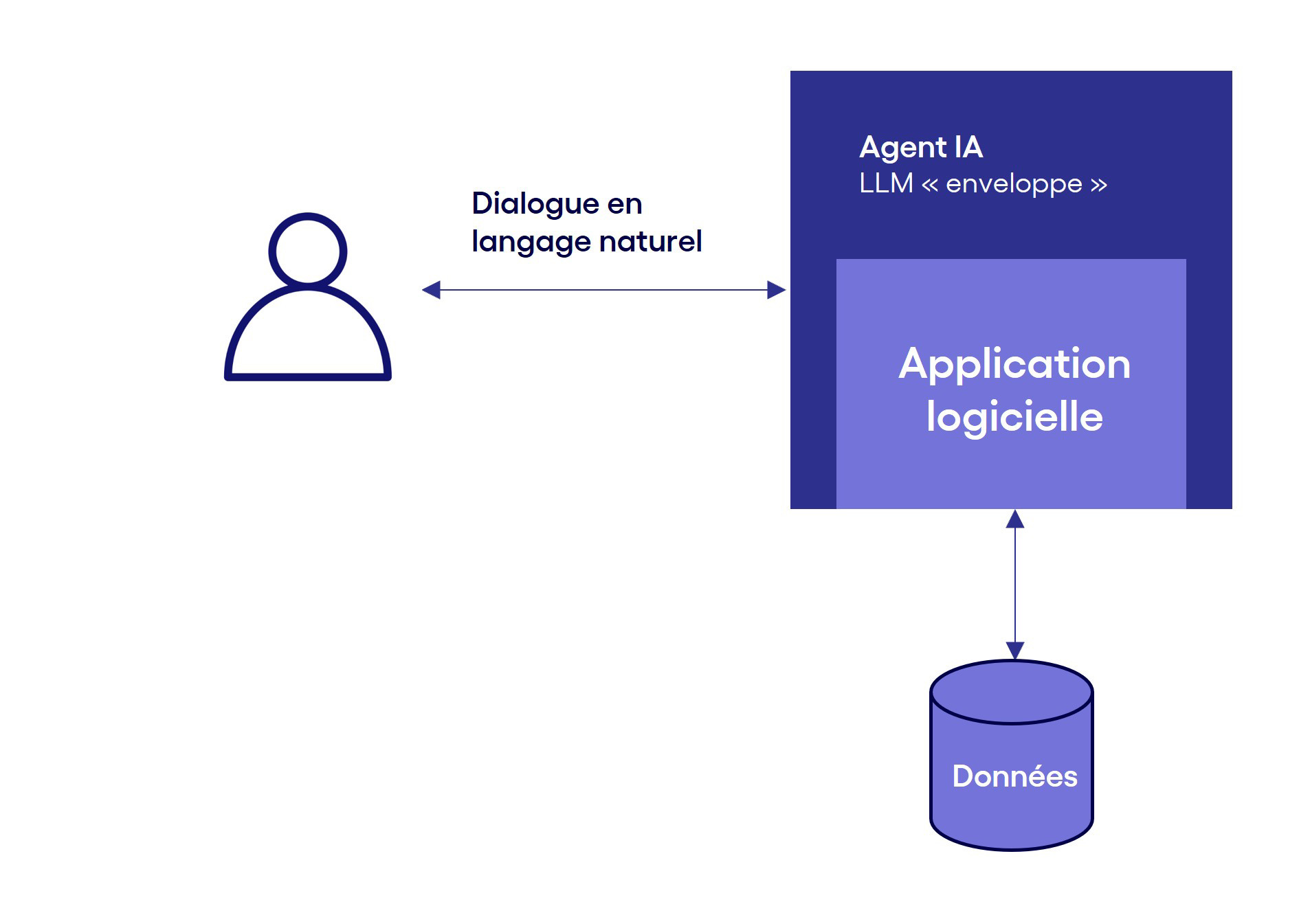

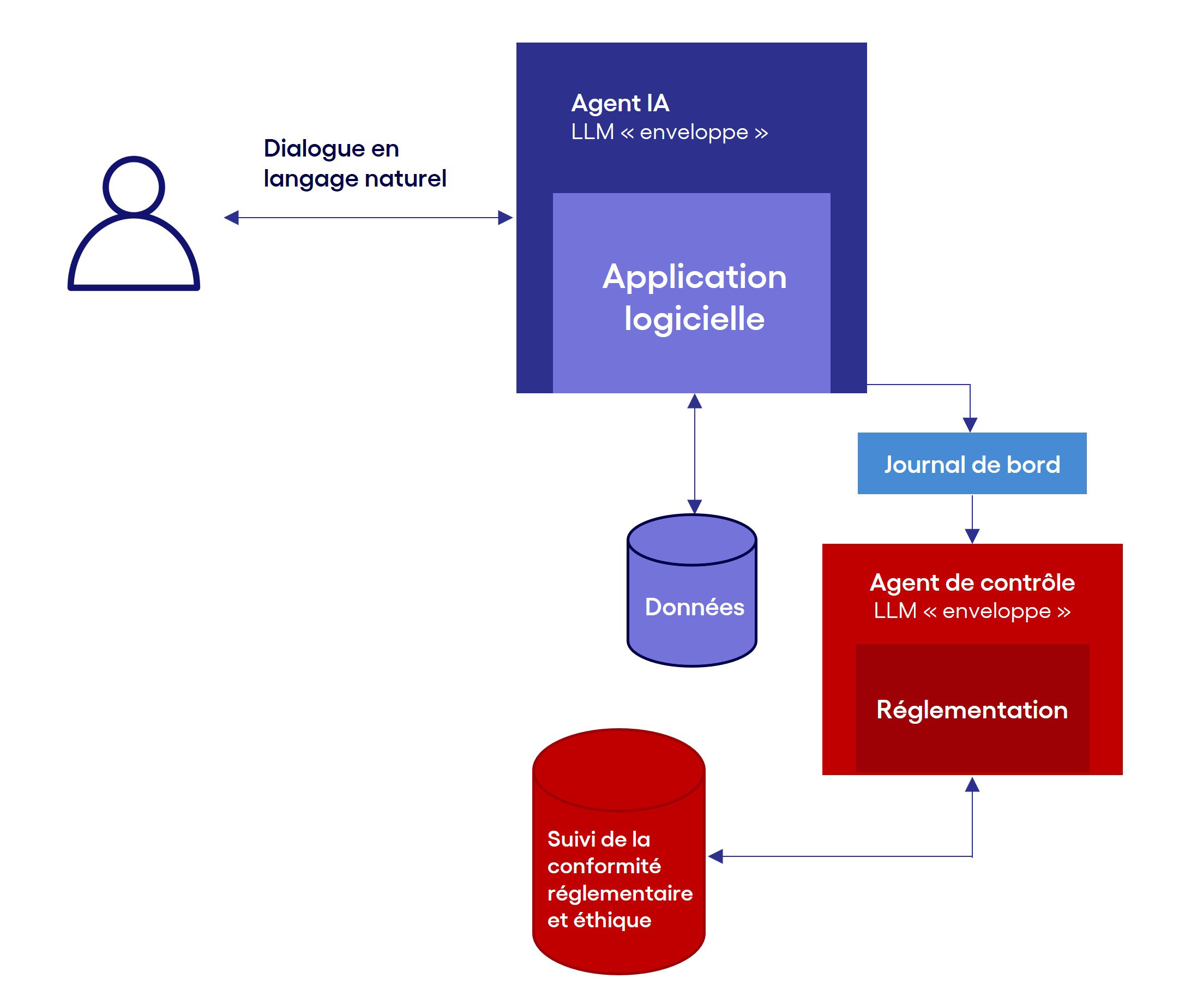

Comme évoqué plus haut, un agent d’intelligence artificielle est un modèle LLM d’IA générative qui enveloppe un module, une fonction, un service ou une base de données pour permettre à des êtres humains d’interagir avec ce programme dans un langage naturel, exactement comme ils le font déjà avec des outils comme ChatGPT (voir la Figure 1).

Figure 1 : Un agent IA

Un agent IA standard